【深度】苹果牌AI计算卡!M5 Max AI性能深度分析!

合集 · 全面分析 深度解析 (52)

-

M2芯片深度解析, 有惊喜, 有失望! 不是苹果想要的那颗芯

16:04

16:04

-

M1 Ultra: 全面评测与深度解析! 苹果牌胶水行不行

25:49

25:49

-

「芯片简史」苹果, 白手起家, 长路漫漫, 道阻且长

22:05

22:05

-

天玑9000:卷!发哥真就硬卷!

9:31

9:31

-

2022年了,iPhone咋还不用Type-C?14Pro也许有戏!

10:44

10:44

-

M1 Max性能全解密! 凑齐7台Mac, 全配置挖掘Mac的小秘密!

19:59

19:59

-

苹果13 Pro: 高刷机制全解密, 2400帧相机一帧一帧看!

20:27

20:27

-

【科普】什么是计算摄像?费这大劲,图个啥?真就是手机未来!?

17:58

17:58

-

【硬核】何为鸿蒙?和安卓的区别到底是什么?别再扯套壳了

15:29

15:29

-

骁龙888怎么了? 三星5nm工艺深度解析! 小米11被高通坑了?

15:34

15:34

-

【干货】你绝对没听过的iPhone12深度解析!取消充电器的真相, iPhone12定位, 激光雷达, ProRAW!

20:16

20:16

-

岂止剪辑,M1 Mac全面测评!为什么M1这么猛?离Pro级芯片还有多远?

17:43

17:43

-

ARM Mac与Apple Silicon:全面解读苹果自研芯片,Intel Mac还能不能买,WWDC没告诉你的,都在这里了

20:39

20:39

-

【干货】Apple Glass提前“发布”,理性分析,全面预测,从技术的角度告诉你Apple Glass到底有什么!

19:16

19:16

-

【全程高能】iPhone12:理性分析,全面预测!高刷屏,无刘海,四摄,A14,需求与技术,理性预测,全程干货,建议提前喝水!

18:34

18:34

-

iPad Pro 2020:这不是iPad,这是ARM Laptop!

14:33

14:33

-

第一台iPad怎么买? 暑期教育优惠·iPad选购指南

13:12

13:12

-

灵动岛鸡肋? 主战场并非iPhone!iPhone 14 Pro测评(上)

7:17

7:17

-

为什么过度锐化?iPhone在毁掉你的照片?iPhone 14 Pro测评(中)

13:56

13:56

-

为什么“核多力量大”?i9-13900K深度测评

13:06

13:06

-

iPhone 14 Plus: 会成为下一部mini吗?iPhone 15系列布局

7:02

7:02

-

ChatGPT为什么厉害?天网维形还是村头大妈?

9:56

9:56

-

臭打游戏之外,还能干些什么?13代i9HX+RTX4080 宏碁掠夺者战斧18性能测试

9:08

9:08

-

M2 Pro工科生产力测试,苹果留了一手?Mac生产力系列(上)

15:35

15:35

-

为什么Mac=视频创作? AI时代下还会是吗?Mac生产力系列(下)

10:57

10:57

-

苹果Vision Pro: 靠什么从虚拟走向现实?

7:25

7:25

-

新款Mac Studio硬核体验,赛博朋克2077能跑多少帧?

7:40

7:40

-

A17性能全面预测,关于iPhone15还有些你不知道的

8:33

8:33

-

不再过度锐化?A17性能如何?iPhone 15发布会5分钟回顾

5:51

5:51

-

iPad Pro M4: AI性能深度分析!苹果大模型要来了

9:48

9:48

-

一次讲透!工科生用Mac,体验如何?

9:27

9:27

-

不只是家庭影院!买了6个HomePod之后,我的建议是....

8:49

8:49

-

A17 NPU性能实测!为什么只有iPhone 15 Pro能用?Apple Intelligence深度解读(一)

13:21

13:21

-

部落还是联盟?魔兽世界Mac完美适配!

7:12

7:12

-

A18,为AIGC而生!iPhone16系列AI性能深度测试

12:10

12:10

-

35瓦GPU挑战700亿参数大模型!苹果M4 Max/M4性能深度分析

12:13

12:13

-

假“手表”之名,行“计算”之实!Apple Watch系列十年回顾

9:13

9:13

-

Mac集群跑DeepSeek等大模型?六台M4 Pro本地大模型推理实测

8:58

8:58

-

速度媲美官网?满血M3 Ultra推理6000亿参数DeepSeek R1

11:18

11:18

-

光追级UI!?WWDC 2025 Liquid Glass技术解析!

4:14

4:14

-

建模太阳磁场、运行本地大模型!为什么学生都爱用Macbook Air?

8:25

8:25

-

【深度】用2T内存的Mac跑AI!对话EXO创始人Alex Cheema

20:41

20:41

-

iPhone 17 Air:苹果折叠屏的前奏

8:19

8:19

-

诚意,诚意,还是诚意!iPhone 17苹果秋季发布会全解析

5:12

5:12

-

全网最细!iPhone 17系列AI性能分析

14:47

14:47

-

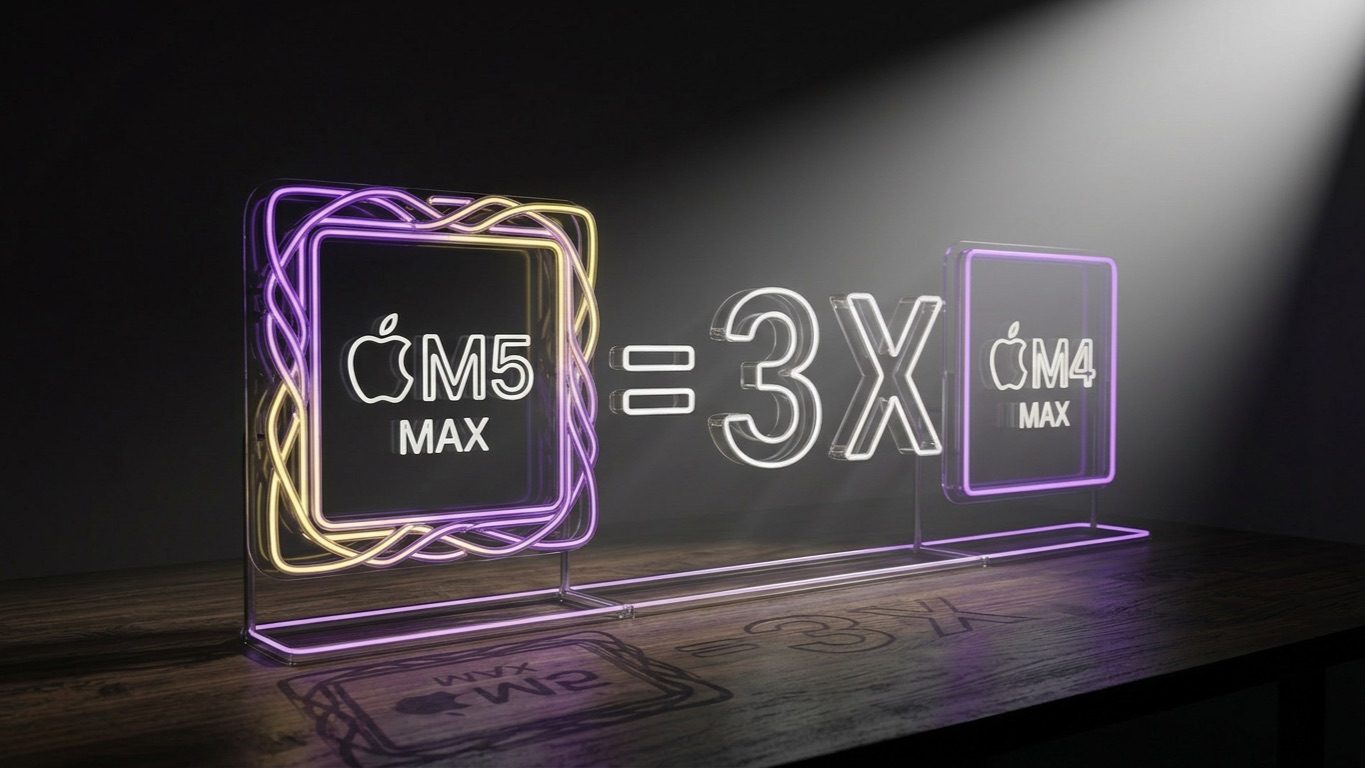

越级表现,超越Pro!M5芯片AI性能深度分析

12:43

12:43

-

iPhone Air深度评测:极简是复杂的最高级形式

8:55

8:55

-

AI一键剪辑,小白救星!Apple创作全家桶深度体验

8:46

8:46

-

【硬核教程】教你搭建Mac AI集群!2TB显存,运行万亿参数大模型!

11:25

11:25

-

【深度】苹果牌AI计算卡!M5 Max AI性能深度分析!

13:05

13:05

-

【深度】MacBook Neo: 苹果最“差”的 Mac,为什么反而最重要?

6:00

6:00

-

NVIDIA DGX Spark:128G统一内存!桌面AI超算Coding实测

8:15

8:15

Description

M5 Max 最不寻常的地方,不是它更快了,而是它变了。它正在脱离传统笔记本 SoC 的逻辑,长出 Apple 专业级 AI 计算卡的轮廓。

Comments

我是小白,我好奇为什么很多人都说在本地部署大语言模型?相比于直接用ChatGPT网页或者软件,有什么优势吗?

♥ 165 ↩ 97

Up的测评很有趣,但存在少许遗憾:没能和N卡做对比。恰好我手里有张5090,大致按照up的测试方法跑一轮,来看看Apple Silicon对比5090是什么样子的吧: 测试平台:9950x3d+5090d魔龙,主板x670e暗黑,cpu pbo增强模式2其余自动,内存皇家寄48g*2=96g 6400c32一键xmp,电源一块硬盘若干,散热猫头鹰全家桶+pa602机箱稳稳压住不是问题 测试使用win11,LM Studio 0.46+1,N卡驱动591.74,Cuda 13.1 测试方法:统一开64k上下文,思考模式开,跑三个模型,Qwen3.5的27b,35b-a3b,122b-a10b,其中35b-a3b使用官方q4量化,其余两个使用unsloth的q4_xl量化。供测试三项,第一项直接问大模型“详细解释一下Clang的LTO和PGO技术”看吐词速度,第二和第三项喂给大模型Clang的用户手册(https://clang.llvm.org/docs/UsersManual.html),长约48k token,让他详细总结一下,统计从发送文本到开始吐第一个词的时间,以及吐词速度 结果如图二,从左往右三列分别对应三项的测试结果(短问答吐词速度,长问答首次吐词等待时间,长问答吐词速度),单位为秒、token每秒,保留至少两位有效数字 特别提醒,122b-a10b的模型在5090上是爆显存的,这项测试的成绩请图一乐 个人看法:毫无疑问在不爆显存的情况下M5Max无论如何在推理上都肘不赢5090。笔记本打台式机有点不公平,但考虑到128GB存储的mbp售价接近4w,这么比也算说得过去吧?要问结论的话,除非你有移动办公还有本地跑大模型推理的需求,且不在意mbp高昂的售价以及生态问题,那mbp是你最好,甚至是唯一的选择。否则,没有移动办公的需求,纯推理请考虑新一代Mac Studio,便宜不少,显得有些性价比。其余情形,特别是站在生态以及兼容性(特别是Cuda)的角度考虑,建议慎重

♥ 484 ↩ 150

MAC系列有没有性价比全看你的需求。你要是把MacBook的统一内存当内存用,MacBook的内存毫无性价比,简直是金子做的。但你要是把MacBook的统一内存当显存用,那相比于老黄的振金显存,MacBook简直太有性价比了[doge_金箍]

♥ 129 ↩ 19

《你只需要专注力》人类读完只用20分钟?我感觉我不配做人

♥ 100 ↩ 5

怎么都老惦记着本地部署模型,性价比低的要命

♥ 84 ↩ 76

Apple 10 GPU可惜的是不支持FP8/MXFP8,希望下次Apple 11能给Shader和NA都支持上。

♥ 53 ↩ 3

prefill强 decode一般,原来是openclaw专用机[星星眼]

♥ 45 ↩ 12

弹幕真不像演的[笑哭]Mac能跑的大模型5090那点32g可怜显存都进不去[笑哭][笑哭]有性能用不出去

♥ 55 ↩ 36

说实话,国内这个免费环境,本地部署除了隐私,随便造的优势就没了。对于国内的免费环境是不如云端的,云端可以用满血大模型,满血大模型需要300-1000gb内存/显存,你要本地部署只能用低精度,低参数的小模型[笑哭]而且苹果的算力根本跑不了多模态,几个开源多模态也没招,关键他又有moe,显卡也能跑

♥ 55 ↩ 38

这期文案的AI味也太浓了吧?虽然是商单,但是作为一个几十万粉的up主,还是要有点自己的思想在里面吧,而不是当AI传话筒。。。

♥ 48 ↩ 22

mac能跑得赢同级别的cuda吗 同价位的

♥ 33 ↩ 44

那M5Ultra岂不是更逆天[doge]

♥ 35 ↩ 52

一人血书求测m5 pro ai性能!!!想看的兄弟给我点赞👍!!!

♥ 34 ↩ 4

没极客湾我只能看你了

♥ 22

其实我不是很能理解为什么都在捣鼓qwen3.5 27B,明显35B的那个更有竞争力,在内存大了30%的情况下,每次只激活相当于27B的1/9的参数,吐字速度明显快一截,不是很香吗

♥ 13 ↩ 6

呃,讲道理,attention is all you need根本不用读吧,llm模型知识库默认带这篇

♥ 13 ↩ 10

神奇的更新时间…… M5家族引入的果味Tensor Core解决了TTFT太长的毒点,真正意义上让dense模型也变得能用了。考虑到MoE目前并未杀死比赛,这让它在未来更有可能成为本地大模型的合格载体

♥ 21 ↩ 1

张黑黑讲的内容超出我知识范围了听不懂,但支持一下! 请教一下张黑黑: 你觉得Apple会推出自己的大语言模型吗?

♥ 20 ↩ 17

我选择h100,部署了27BFP8,开启mtp与256k上下文刚好吃满80g显存,16k上下文情况下prefill约10000 token/s,decode 100token/s(单并发[脱单doge]

♥ 21 ↩ 7

为什么有人总盯着性能/速度的数字而忽略了显存本身是否能支持模型?128gmac部署大模型就算再慢他起码能跑,你搞个同价位48g5090他根本跑都跑不起来,速度再快有什么用?

♥ 31 ↩ 9