【深度】比YU7还贵的Mac跑AI!对话EXO创始人Alex Cheema

合集 · 全面分析 深度解析 (52)

-

M2芯片深度解析, 有惊喜, 有失望! 不是苹果想要的那颗芯

16:04

16:04

-

M1 Ultra: 全面评测与深度解析! 苹果牌胶水行不行

25:49

25:49

-

「芯片简史」苹果, 白手起家, 长路漫漫, 道阻且长

22:05

22:05

-

天玑9000:卷!发哥真就硬卷!

9:31

9:31

-

2022年了,iPhone咋还不用Type-C?14Pro也许有戏!

10:44

10:44

-

M1 Max性能全解密! 凑齐7台Mac, 全配置挖掘Mac的小秘密!

19:59

19:59

-

苹果13 Pro: 高刷机制全解密, 2400帧相机一帧一帧看!

20:27

20:27

-

【科普】什么是计算摄像?费这大劲,图个啥?真就是手机未来!?

17:58

17:58

-

【硬核】何为鸿蒙?和安卓的区别到底是什么?别再扯套壳了

15:29

15:29

-

骁龙888怎么了? 三星5nm工艺深度解析! 小米11被高通坑了?

15:34

15:34

-

【干货】你绝对没听过的iPhone12深度解析!取消充电器的真相, iPhone12定位, 激光雷达, ProRAW!

20:16

20:16

-

岂止剪辑,M1 Mac全面测评!为什么M1这么猛?离Pro级芯片还有多远?

17:43

17:43

-

ARM Mac与Apple Silicon:全面解读苹果自研芯片,Intel Mac还能不能买,WWDC没告诉你的,都在这里了

20:39

20:39

-

【干货】Apple Glass提前“发布”,理性分析,全面预测,从技术的角度告诉你Apple Glass到底有什么!

19:16

19:16

-

【全程高能】iPhone12:理性分析,全面预测!高刷屏,无刘海,四摄,A14,需求与技术,理性预测,全程干货,建议提前喝水!

18:34

18:34

-

iPad Pro 2020:这不是iPad,这是ARM Laptop!

14:33

14:33

-

第一台iPad怎么买? 暑期教育优惠·iPad选购指南

13:12

13:12

-

灵动岛鸡肋? 主战场并非iPhone!iPhone 14 Pro测评(上)

7:17

7:17

-

为什么过度锐化?iPhone在毁掉你的照片?iPhone 14 Pro测评(中)

13:56

13:56

-

为什么“核多力量大”?i9-13900K深度测评

13:06

13:06

-

iPhone 14 Plus: 会成为下一部mini吗?iPhone 15系列布局

7:02

7:02

-

ChatGPT为什么厉害?天网维形还是村头大妈?

9:56

9:56

-

臭打游戏之外,还能干些什么?13代i9HX+RTX4080 宏碁掠夺者战斧18性能测试

9:08

9:08

-

M2 Pro工科生产力测试,苹果留了一手?Mac生产力系列(上)

15:35

15:35

-

为什么Mac=视频创作? AI时代下还会是吗?Mac生产力系列(下)

10:57

10:57

-

苹果Vision Pro: 靠什么从虚拟走向现实?

7:25

7:25

-

新款Mac Studio硬核体验,赛博朋克2077能跑多少帧?

7:40

7:40

-

A17性能全面预测,关于iPhone15还有些你不知道的

8:33

8:33

-

不再过度锐化?A17性能如何?iPhone 15发布会5分钟回顾

5:51

5:51

-

iPad Pro M4: AI性能深度分析!苹果大模型要来了

9:48

9:48

-

一次讲透!工科生用Mac,体验如何?

9:27

9:27

-

不只是家庭影院!买了6个HomePod之后,我的建议是....

8:49

8:49

-

A17 NPU性能实测!为什么只有iPhone 15 Pro能用?Apple Intelligence深度解读(一)

13:21

13:21

-

部落还是联盟?魔兽世界Mac完美适配!

7:12

7:12

-

A18,为AIGC而生!iPhone16系列AI性能深度测试

12:10

12:10

-

35瓦GPU挑战700亿参数大模型!苹果M4 Max/M4性能深度分析

12:13

12:13

-

假“手表”之名,行“计算”之实!Apple Watch系列十年回顾

9:13

9:13

-

Mac集群跑DeepSeek等大模型?六台M4 Pro本地大模型推理实测

8:58

8:58

-

速度媲美官网?满血M3 Ultra推理6000亿参数DeepSeek R1

11:18

11:18

-

光追级UI!?WWDC 2025 Liquid Glass技术解析!

4:14

4:14

-

建模太阳磁场、运行本地大模型!为什么学生都爱用Macbook Air?

8:25

8:25

-

【深度】用2T内存的Mac跑AI!对话EXO创始人Alex Cheema

20:41

20:41

-

iPhone 17 Air:苹果折叠屏的前奏

8:19

8:19

-

诚意,诚意,还是诚意!iPhone 17苹果秋季发布会全解析

5:12

5:12

-

全网最细!iPhone 17系列AI性能分析

14:47

14:47

-

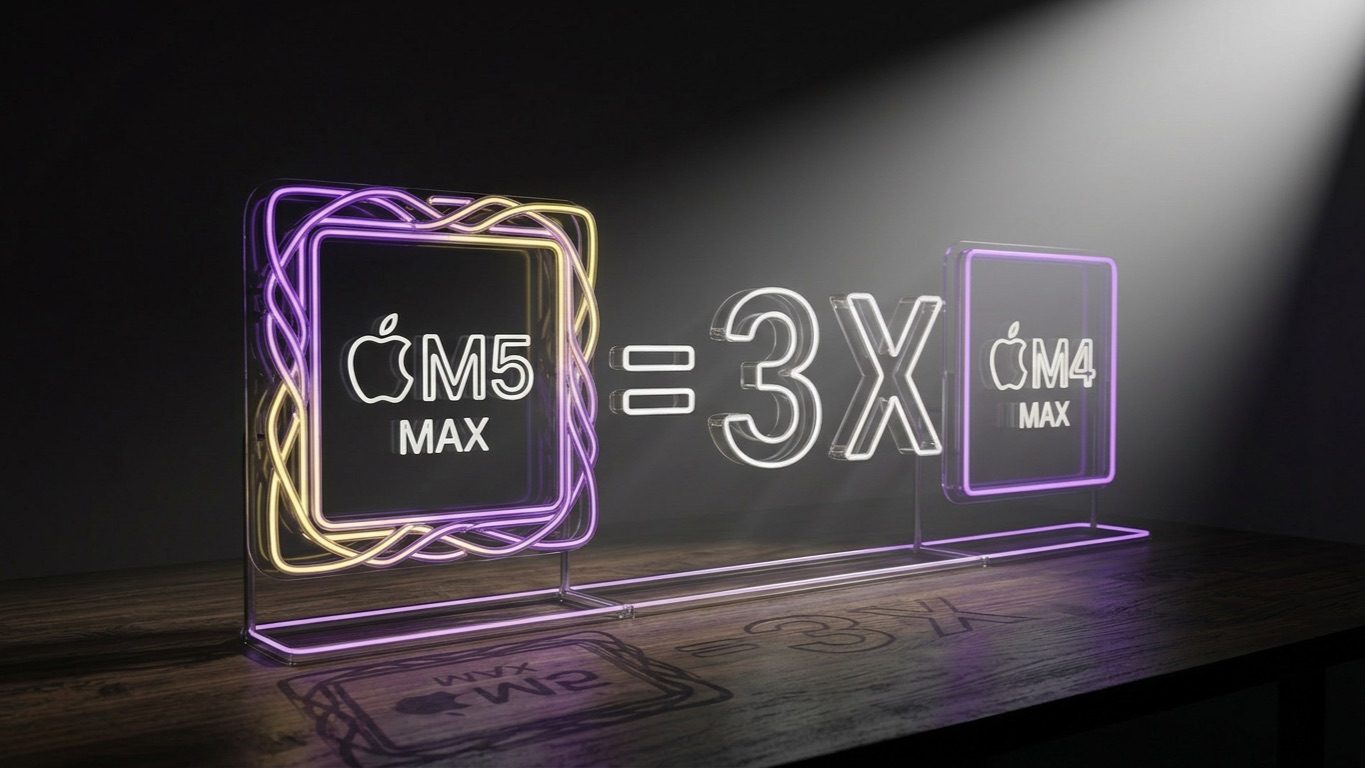

越级表现,超越Pro!M5芯片AI性能深度分析

12:43

12:43

-

iPhone Air深度评测:极简是复杂的最高级形式

8:55

8:55

-

AI一键剪辑,小白救星!Apple创作全家桶深度体验

8:46

8:46

-

【硬核教程】教你搭建Mac AI集群!2TB显存,运行万亿参数大模型!

11:25

11:25

-

【深度】苹果牌AI计算卡!M5 Max AI性能深度分析!

13:05

13:05

-

【深度】MacBook Neo: 苹果最“差”的 Mac,为什么反而最重要?

6:00

6:00

-

NVIDIA DGX Spark:128G统一内存!桌面AI超算Coding实测

8:15

8:15

Description

exoLabs的创始人Alex向我们展示了他们的下一代产品,exo2。并使用四台顶配的M3 Ultra Mac Studio组建起群,本地并行推理V3+R1模型。我也是得到了一个难得的机会,与exoLabs的创始人Alex Cheema进行了访谈对话,围绕本地大模型推理,exoLabs展开了讨论。

Comments

44w人民币,400w功耗...这性价比确实能把老黄的卡比下去[笑哭],重点是省电啊

♥ 564 ↩ 46

最有趣的是四台连在一起也比一个台式机大不了那去,哈哈哈

♥ 208 ↩ 11

评论区好多懂哥觉得低功耗没意义,实际上对企业来说那电费动不动就是几千万

♥ 88 ↩ 22

很多人一直鼓吹ARM,实则没看多少书,ARM是RISC,X86是CISC,RISC只有在低并发、高吞吐的计算、可并行拆分的任务下才能体现优势,比如手机平板微处理器,但是对于依赖高单线程频率的处理,能效比仍然很低,还有需要极大缓存或带宽的场景(天气预测,空气动力学仿真等),至于功耗,全球超算排名第二的Fugaku的arm 处理器A64FX TDP 约 200W,全系统(158,976 个节点)总功耗接近 30 MW。全球超算排名第一的Frontier(AMD EPYC + GPU)以 AMD EPYC 7A53(TDP 280W)配合 GPU 构成,功耗约 21 MW,性能更高(FLOPS 高出 Fugaku 近 2 倍),功耗小了不少,并且PCIe 5.0/6.0都是在x86首测的,方便大规模 GPU、FPGA、加速卡的部署。特别是在超算里 I/O 带宽直接影响整体性能。还有x86也在不断改进,AMD的Chiplet 技术和3D堆叠,特别是zen5架构,有着更高 IPC、更多核心、更低功耗,重点优化 AI 加速指令。INTEL还有性能核和效率核混合设计(不过intel再用14nm++++,怎么改都没用),虽然ARM也有SVE,效率仍然不如AVX,,我只能说未来是多架构并存,各自发挥长处,竞争和协作并存的格局(X86很难做嵌入式,但RISC-V、ARM就行),而非单一架构全面胜出。(手打不易,有错请纠)

♥ 77 ↩ 26

这可是比小米YU7 max还要贵的Mac[doge_金箍]

♥ 40 ↩ 6

我用我的 Mac Studio M3 Ultra 512GB 在 LM Studio 上运行 openai/gpt-oss-120b (8bit) (124GB大小) 的模型速度在55token/s.

♥ 38 ↩ 2

内存比我硬盘都大

♥ 36

这种东西看看就行了,动真格还得看苹果官方下场。 苹果现在非常在意AI领域,但是时间台紧迫,m3ultra只为迎合deepseek浪潮,整了个超大内存版,但技术上和m2ultra其实没有什么变化 等出了m4u、m5u,技术更新一波,并且内存上限继续拉高,这种第三方的玩具就毫无性价比了

♥ 35 ↩ 2

雷电网络,上限就是4台了吧

♥ 32 ↩ 4

这才40来万[笑哭]性价比确实拉满,比老黄好

♥ 31 ↩ 6

跑一下8,16,32,64并发,看一下TPS,TTFT,TPM这些参数吧。光看单用户输出,不能证明在商业环境好用

♥ 30 ↩ 4

不看好,mac 的并行单元数放在那,就算一个请求能到20tokens,并发一上来模型prefill阶段就能慢得没法用,ultra 还是适合工作站。运行小模型,比如qwen235 gptoss glm4.5air 这个价格不如买8卡5090。甚至sglang 英特尔xeon6 那个推理方案我都觉得更靠谱,两颗6980配个2tb内存,主要cpu方案更灵活,不跑大模型模型了跑其他软件集群都能用

♥ 19

帶寬仲要提升

♥ 17

太棒了已三连[鸡腿]永远可以相信黑黑的视频[星星眼] 几点印象: EXO的初心和目标就是:只要是有算力的设备,就可以串起来自动分配任务合力计算 MOE的架构使得大内存更重要,相比稠密模型,每次需要激活较少的参数,所以算力需求更少,tokens/s更高 TB5使得设备互联速率更快,对模型推理也有帮助 LLM作为“外脑”,本地随时调用还是更方便,本地跑LLM的需求一定有,可能还会更大

♥ 17

我的M4 Max运行qwen30b,98tokens/秒

♥ 13

不明白大家为什么这样死脑筋。追cuda肯定是要沉淀的,但Mac主打的是能耗比和噪音控制,对于个人,我也有win pc但是我还要干其他的事情,打游戏什么的,在win上用更高效的cuda微调完模型把权重文件给mac再去跑推理,非常安静,又特别省电,换成cuda跑可能就快个十几秒,我又不在乎,我打我的游戏就好了,刚好还能给Mac找点事做。

♥ 11 ↩ 1

没太明白为什么非得用mac跑个人推理级AI,明明1-2张RTX pro 6000也行

♥ 9 ↩ 8

我在思考一个事,如果未来制造出了仿生人形机器人,那机器人的体内空间能装下用于支持它各种ai软件的gpu吗,比如说最核心负责意识和思考的ai(大脑),还有周边处理传感器数据的ai(小脑)

♥ 9 ↩ 11

所以这四台 mac stuio 的推理能力是不是跑不过一台 H20? 毕竟那边阉割的只剩推理能力了,mac 也几乎没法炼丹。。。H20 价格是 10 万rmb不到, 买四张 H20 也可。。。。

♥ 9 ↩ 5